Google は、世界的なクラウドシステム市場で12%のシェアを持つ大手クラウドサービスプロバイダーです。同社は、より高速なサービスを提供するために事業拡大を目指しており、このたび、NVIDIA社製のBlackwell GB200 NVLラックを採用したことを発表しました。

カスタマイズされたGB200 NVLラックによる高性能コンピューティング

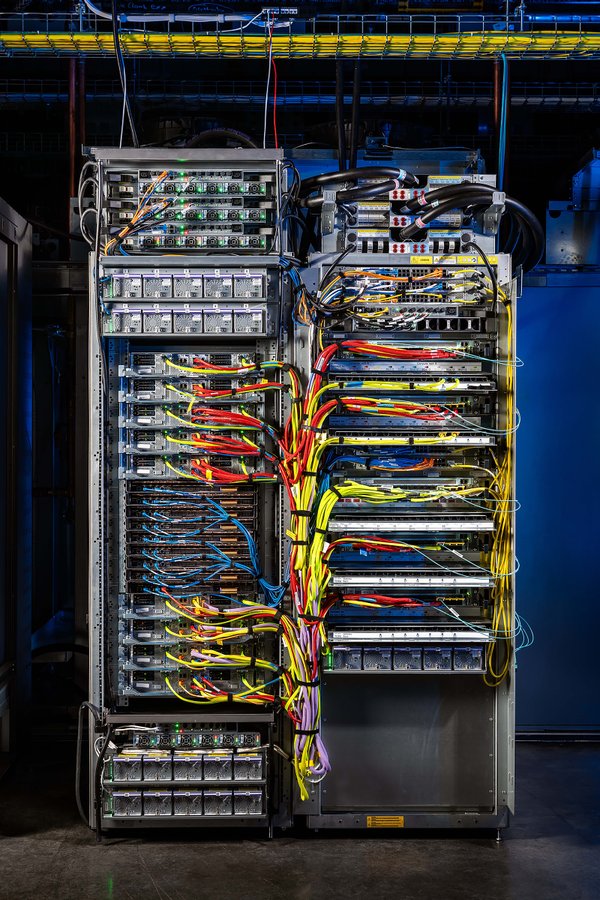

Google Cloudは、NVIDIA社と緊密に連携し、GB200 NVLラックをカスタマイズすることで、将来のコンピューティングインフラを持続可能な方法で構築しています。

各GB200チップには、1つのGrace CPUと1つのB200 Blackwellベースのデータセンター用グラフィックチップが搭載され、驚異的な90 TFLOPSのFP64性能を実現しています。

液冷式GPU搭載で高効率な演算処理を実現

Google Cloudが採用したGB200 NVLラックは、液冷式のGB200高性能チップを搭載しています。これにより、高い演算性能を維持しつつ、効率的な冷却が可能になります。公式のNVIDIA GB200 NVL72では、36基のGrace CPUと72基のB200 GPUが組み合わされ、最大130 TB/sのバンド幅を提供します。また、1ラックあたり3240 TFLOPSのFP64性能と13.5 TBのHBM3eメモリを実現しています。

業界をリードするAIチップで様々な分野での活用が進む

GoogleだけでなくMicrosoftなどの大手企業も、GB200チップを採用したシステムを導入しています。台湾のFoxconnは、GB200 NVL72ラックを用いて台湾最速のスーパーコンピューターを構築中です。LLM、医療研究、クラウドストレージ、AIワークロードなど、様々な分野でGB200チップの強力な演算性能が活用されています。NVIDIAのBlackwellは現在量産段階にあり、今後さらに多くのシステムで業界をリードするAIチップが採用されると期待されます。

まとめ

Google Cloudは、NVIDIA社製のBlackwell GB200 NVLラックを採用することで、AIクラウドプラットフォームの強化を図っています。カスタマイズされた液冷式GPUを搭載したGB200 NVLラックにより、高性能コンピューティングと効率的な冷却を実現しました。GB200チップは、様々な分野で活用が進んでおり、今後もAI分野をリードする重要な役割を果たすでしょう。